Kaip rodo pavadinimas, nugaros dauginimas yra algoritmas kad nugara skleidžia klaidas iš išvesties mazgų į įvesties mazgus. Todėl tai tiesiog vadinama „atgaliniu klaidų plitimu“. Šis požiūris buvo sukurtas analizuojant žmogaus smegenis. Kalbos atpažinimas, simbolių atpažinimas, parašo tikrinimas, žmogaus ir veido atpažinimas yra keletas įdomių neuroninių tinklų programų. Neuroniniai tinklai eina per prižiūrimą mokymąsi, per tinklą einantis įvesties vektorius sukuria išėjimo vektorių. Šis išvesties vektorius patikrinamas pagal norimą išvestį. Jei rezultatas neatitinka išvesties vektoriaus, sukuriama klaidų ataskaita. Remiantis klaidų ataskaita, svoriai koreguojami, norint gauti norimą rezultatą.

Kas yra dirbtinis neuroninis tinklas?

An Dirbtinis neuronų tinklas taiko prižiūrimą mokymosi taisyklę, kad taptų veiksminga ir galinga. Informacija nerviniuose tinkluose teka dviem skirtingais būdais. Visų pirma, kai modelis yra mokomas ar mokomas ir kai modelis veikia normaliai - arba bandymams, arba naudojamas bet kuriai užduočiai atlikti. Įvairių formų informacija į modelį įvedama per įvesties neuronus, suaktyvinant kelis paslėptų neuronų sluoksnius ir pasiekiant išėjimo neuronus, kurie yra žinomi kaip grįžtamojo tinklo.

Kadangi visi neuronai neveikia tuo pačiu metu, neuronai, gaunantys įvadus iš kairės, keliaujant per paslėptus sluoksnius, dauginami su svoriais. Dabar susumuokite visas kiekvieno neurono įvestis ir, kai suma viršija tam tikrą slenksčio lygį, tylėję neuronai suveiks ir prisijungs.

Dirbtinis neuroninis tinklas mokosi taip, kad jis mokosi iš to, ką padarė blogai ir elgiasi teisingai, ir tai vadinama grįžtamuoju ryšiu. Dirbtiniai neuroniniai tinklai naudoja grįžtamąjį ryšį, kad sužinotų, kas yra teisinga ir neteisinga.

Kas yra „Backpropagation“?

Apibrėžimas: Nugaros dauginimas yra esminis nervų tinklų mokymosi mechanizmas. Tai yra mechanizmas, naudojamas norint sureguliuoti nervinio tinklo svorį (kitaip šiame straipsnyje vadinamas modeliu) atsižvelgiant į klaidų lygį, gautą ankstesnėje iteracijoje. Tai panašu į tai, kad pasiuntinys praneša modeliui, jei tinklas padarė klaidą ar ne iš karto, kai tai numatė.

backpropation-neuroninis-tinklas

Neuroninių tinklų plitimas yra apie užkrato pernešimas informacijos susiejimas su modelio sugeneruota klaida spėjant. Šiuo metodu siekiama sumažinti paklaidą, kuri kitaip vadinama nuostolių funkcija.

Kaip veikia užpylimas - paprastas algoritmas

Gilaus mokymosi atkūrimas yra standartinis požiūris į dirbtinių neuroninių tinklų mokymą. Tai veikia taip: - Iš pradžių, kai projektuojamas neuroninis tinklas, atsitiktinės vertės priskiriamos kaip svoriai. Vartotojas nėra tikras, ar priskirtos svorio vertės yra teisingos, ar tinka modeliui. Dėl to modelis pateikia vertę, kuri skiriasi nuo faktinės ar numatomos išvesties, o tai yra klaidos reikšmė.

Norint gauti tinkamą rezultatą su minimalia paklaida, modelį reikia mokyti pagal atitinkamą duomenų rinkinį ar parametrus ir stebėti jo pažangą kiekvieną kartą, kai jis numato. Neuroninis tinklas turi ryšį su paklaida, taigi, kai keičiasi parametrai, pakinta ir klaida. Užpakalinis skleidimas naudoja metodą, vadinamą delta taisykle arba gradiento nusileidimu, kad pakeistų modelio parametrus.

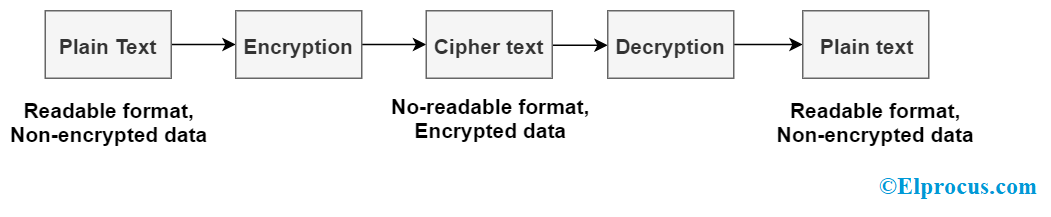

Pirmiau pateiktoje diagramoje parodytas nugaros dauginimo darbas, o jo veikimas pateiktas žemiau.

- „X“ įėjimuose pasiekia iš anksto sujungtą kelią

- „W“, įvesties modeliavimui naudojami tikrieji svoriai. W reikšmės yra atsitiktinai paskirstytos

- Kiekvieno neurono išėjimas apskaičiuojamas persiunčiant į priekį - įvesties sluoksnis, paslėptas sluoksnis ir išvesties sluoksnis.

- Klaida apskaičiuojama išėjimuose, naudojant lygtį, kuri vėl sklinda atgal per išvesties ir paslėptus sluoksnius, svoriai koreguojami, siekiant sumažinti klaidą.

Vėlgi skleiskite į priekį, kad apskaičiuotumėte išvestį ir klaidą. Jei klaida sumažinama iki minimumo, šis procesas baigiasi arba kitaip plinta atgal ir koreguoja svorio vertes.

Šis procesas kartojamas tol, kol klaida sumažėja iki minimumo ir gaunama norima išvestis.

Kodėl mums reikia dauginti?

Tai yra mechanizmas, naudojamas nervų tinklui, susijusiam su konkrečiu duomenų rinkiniu, mokyti. Kai kurie iš „Backpropagation“ privalumai yra

- Tai paprasta, greita ir lengva programuoti

- Sureguliuojami tik įvesties numeriai, o ne kiti parametrai

- Nereikia turėti išankstinių žinių apie tinklą

- Jis yra lankstus

- Standartinis požiūris ir veikia efektyviai

- Tai nereikalauja, kad vartotojas išmoktų specialių funkcijų

Backpropagation tinklo tipai

Yra dviejų rūšių dauginimo tinklai. Jis skirstomas taip:

Statinis užpylimas

Statinis pagrindinio plitimo būdas yra vienas iš tinklo tipų, kurio tikslas - parengti statinio įvesties statistinį išvestį žemėlapį. Tokio tipo tinklai gali išspręsti statinio klasifikavimo problemas, tokias kaip optinis simbolių atpažinimas (OCR).

Pasikartojantis apaugimas

Pasikartojantis užpylimas yra dar vienas tinklo tipas, naudojamas mokantis fiksuoto taško. Pasikartojančio atgalinio dauginimo aktyvacijos yra perduodamos į priekį, kol ji pasiekia fiksuotą vertę. Po to apskaičiuojama klaida ir skleidžiama atgal. A programinė įranga , „NeuroSolutions“ turi galimybę atlikti pasikartojantį dauginimąsi atgal.

Pagrindiniai skirtumai: statinis užpylimas suteikia galimybę nedelsiant susieti žemėlapį, o kartotinis pasiskirstymas - ne iš karto.

Backpragation trūkumai

Nugaros dauginimo trūkumai yra šie:

- Galinis skleidimas gali būti jautrus triukšmingiems duomenims ir pažeidimams

- Tai labai priklauso nuo įvesties duomenų

- Reikia per daug laiko treniruotėms

- Matriciniu metodu reikalingas atgalinis dauginimasis, o ne mini partija

„Backpropagation“ programos

Paraiškos yra

- Neuroninis tinklas yra išmokytas ištarti kiekvieną žodžio ir sakinio raidę

- Jis naudojamas kalbos atpažinimas

- Jis naudojamas simbolių ir veido atpažinimo srityje

DUK

1). Kodėl mums reikia dauginti nervinius tinklus?

Tai yra mechanizmas, naudojamas nervų tinklui, susijusiam su konkrečiu duomenų rinkiniu, mokyti

2). Koks yra backpropagation algoritmo tikslas?

Šio algoritmo tikslas yra sukurti neuroninių tinklų mokymo mechanizmą, siekiant užtikrinti, kad tinklas būtų išmokytas atvaizduoti įvestį į atitinkamą jų išvestį.

3). Koks yra nervų tinklų mokymosi greitis?

Mokymosi greitis apibrėžiamas optimizuojant ir sumažinant nervinio tinklo nuostolių funkciją. Tai reiškia greitį, kuriuo neuroninis tinklas gali sužinoti naujus duomenis, nepaisydamas senų duomenų.

4). Ar neuroninis tinklas yra algoritmas?

Taip. Neuroniniai tinklai yra mokymosi algoritmų arba taisyklių, skirtų šablonams identifikuoti, serija.

5). Kokia yra nervų tinklo aktyvavimo funkcija?

Neuroninio tinklo aktyvavimo funkcija nusprendžia, ar neuronas turėtų būti įjungtas / įjungtas, ar ne, atsižvelgiant į bendrą sumą.

Šiame straipsnyje „Backpropagation“ sąvoka neuronų tinklų dalis paaiškinama naudojant paprastą kalbą, kad skaitytojas suprastų. Taikant šį metodą, neuroniniai tinklai mokomi iš sugeneruotų klaidų, kad taptų savarankiški ir tvarkytų sudėtingas situacijas. Neuroniniai tinklai turi galimybę tiksliai mokytis pagal pavyzdį.